机器之心报道

编辑:Panda

昨晚,深度求索在用户群里宣布「DeepSeek 线上模型版本已升级至 V3.1,上下文长度拓展至 128k」并更新了 UI (去掉了 DeepThink 旁的 R1 标示)之后,在 Hugging Face 发布了一款新模型 DeepSeek-V3.1-Base。

模型地址:https://huggingface.co/deepseek-ai/DeepSeek-V3.1-Base

从名字也能看出来,该模型是 DeepSeek-V3 系列最新的基础模型。至于为什么命名为 V3.1,而不是像之前以前命名为 V3 带四位日期数字的形式(如 V3-0324),尽管社区有诸多猜测,但深度求索官方尚未给出明确说明 —— 和该公司之前的操作一样,这一次同样是模型先行,说明和宣传还在后面。

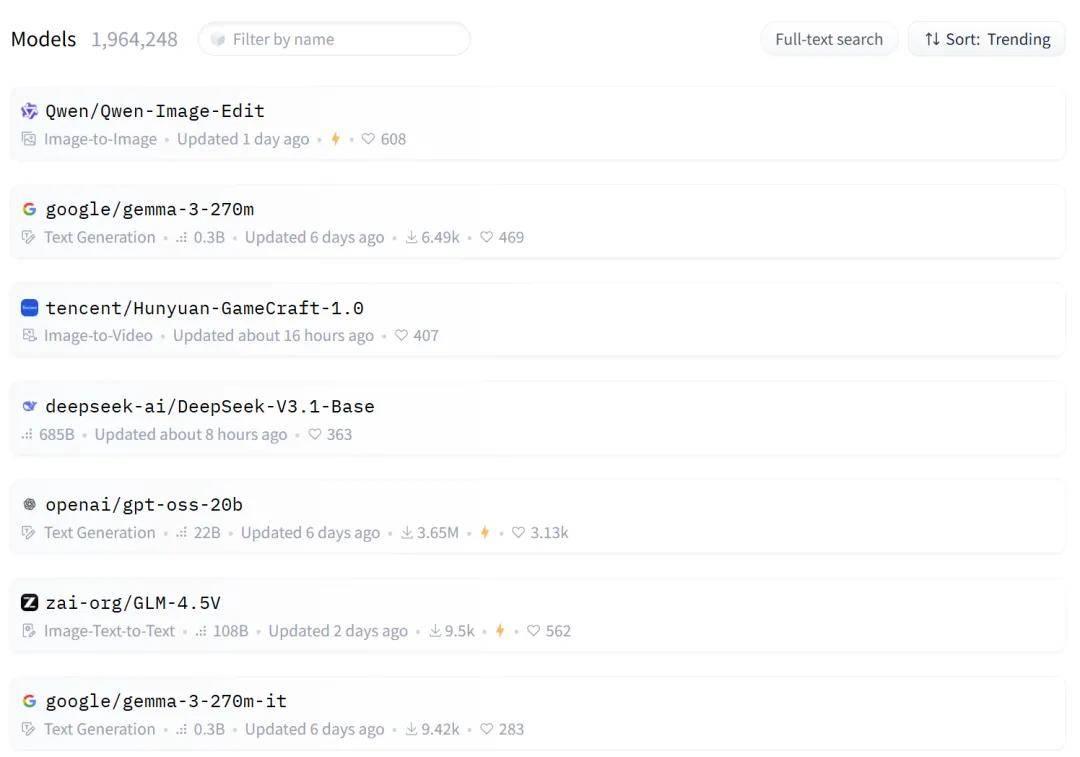

该模型一发布就吸引了 AI 社区的广泛关注,短短几个小时就已经冲上了 Hugging Face 热门模型榜第 4 位!

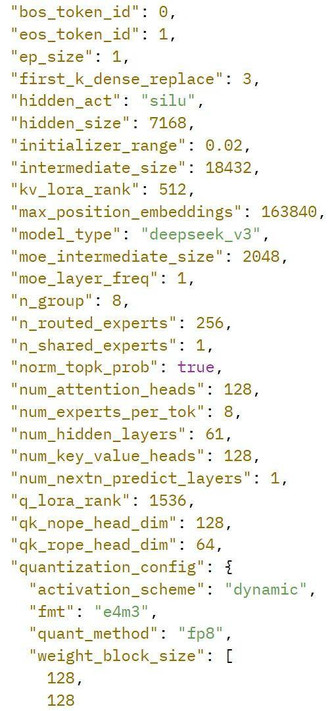

具体技术指标上,DeepSeek-V3.1-Base 与 DeepSeek-V3 差别不大,同样的参数量,采用了混合专家(MoE)架构,拥有 128k 上下文长度。

整体来看,社交网络上对深度求索的这次更新看法不一。有人表示非常振奋,认为这是深度求索在为接下来的 DeepSeek-V4 和 DeepSeek-R2 做铺垫,但也有人认为这次更新不够亮眼,没有达到该公司之前的一贯水准。

对此,你怎么看?