编辑:Aeneas

【新智元导读】GPT-5的新爆料又来了!GPT-5-Alpha已经由Cursor团队内部测试,几乎能一次性完成任何任务;Perplexity已在网站上完成GPT-5发布的准备工作;微软工程师也在紧锣密鼓为GPT-5做准备,将很快在Copilot中发布。GPT-5,它真的越来越近了。

每天一睁眼,都能感觉GPT-5更近了一点。

刚刚,又是一大波关于GPT-5的消息曝出。

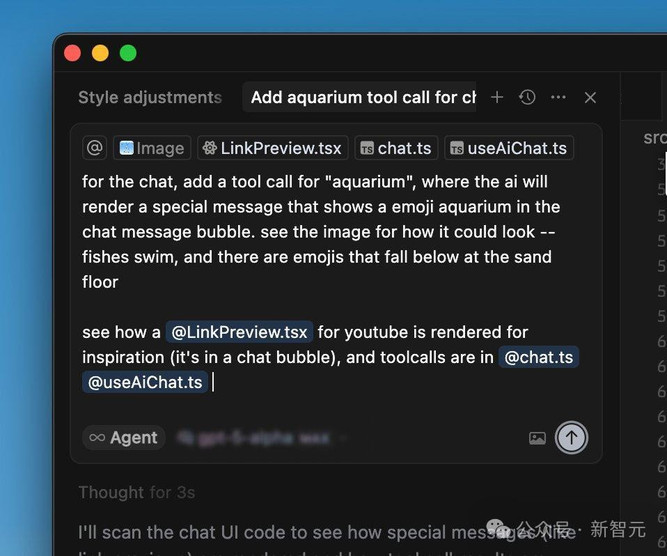

首先,GPT-5-Alpha已经在由Cursor团队内部测试。这个模型表现惊艳,几乎能一次性完成任何任务。

比如下面这个「水族馆游戏」的挑战,模型就顺利完成了。

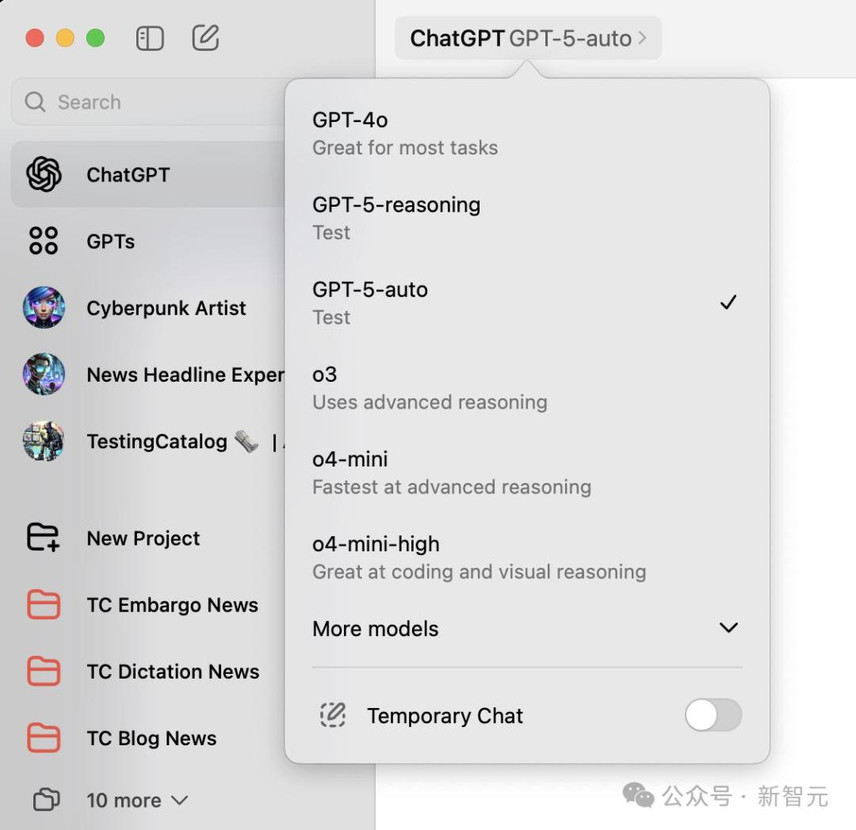

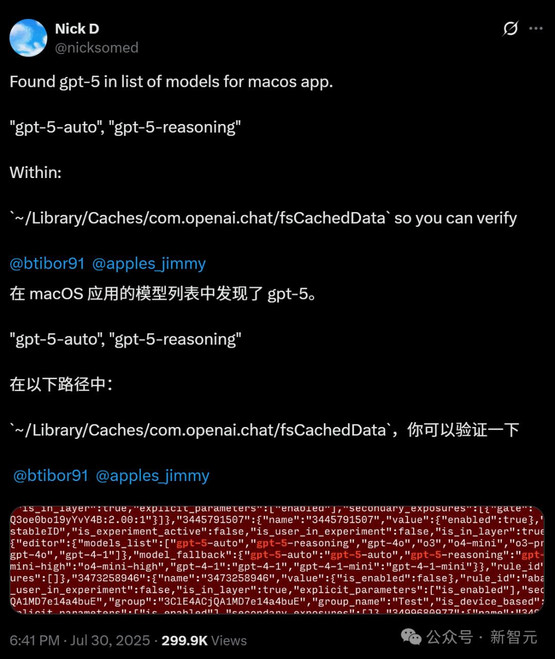

并且就在几小时前,在macOS ChatGPT应用中,已经有人发现了GPT-5-Auto和GPT-5-Reasoning模型。

有眼尖的网友注意到了泄露信息中「reasoning」这个字眼,猜测道:这表明GPT-5很可能已经有了o系列模型。

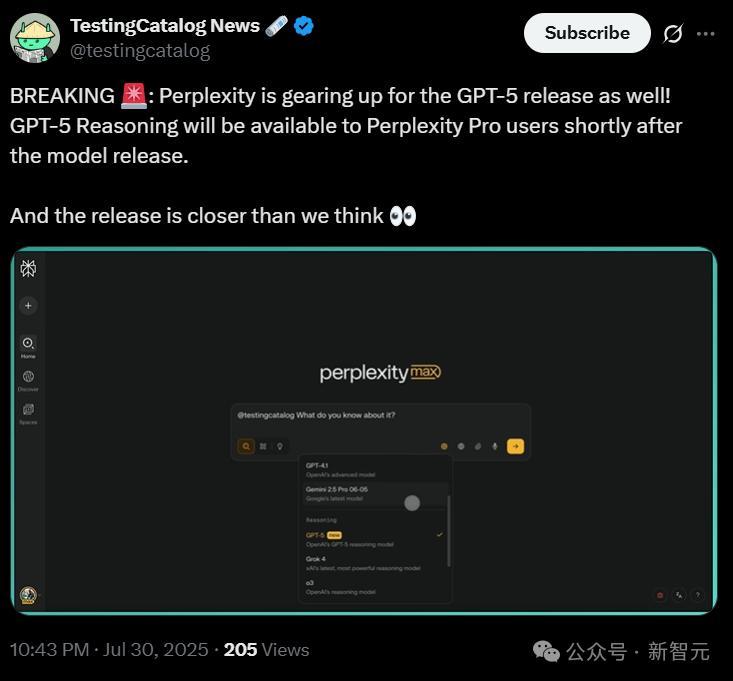

同时,Perplexity已经在网站上完成了GPT-5发布的准备工作。一旦GPT-5发布,Perplexity Pro的用户就能立刻使用了。

微软已准备在AI套件中发布GPT-5

同时,已经有人发现,微软的Copilot Smart Mode,将由GPT-5提供支持。

有人猜测,GPT-5的路由器部分可能已经在逐步推出。

总之,微软正准备在AI套件中发布GPT-5,包括Copilot(消费者版)和 Microsoft 365 Copilot(企业/工作版),以及Azure(企业/API客户)。

据悉,Windows 11的Copilot应用程序具有「智能」模式,可以根据查询在GPT-5的推理/非推理模式之间切换。

甚至,Windows 11 Copilot的免费版,也将拥有基于GPT-5的「智能」模式,因此GPT-5并不会仅限于付费用户使用。

微软工程师,紧锣密鼓为GPT-5做准备

同时,The Verge也刚刚发文表示,微软正在准备推出GPT-5的全新Copilot智能模式。

据微软内部人士透露,微软正在消费者版和商业版的Microsoft 365 Copilot中测试GPT-5的智能模式,这就跟上面的爆料吻合了。

而且据说,在消费者版中,这个模式中的AI可以「根据任务进行深度或快速思考」,所以用户无需选择模型。

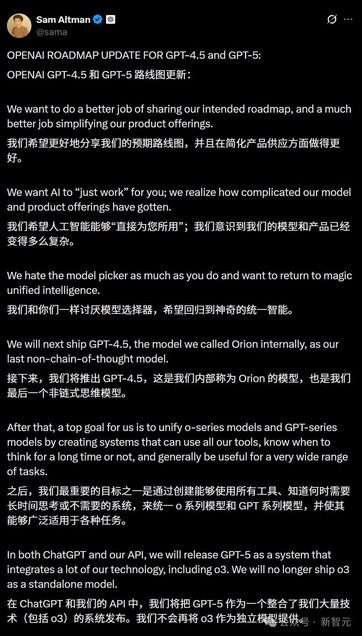

这也跟奥特曼此前透露的想法相一致。

奥特曼在二月表示,「我们和你们一样讨厌模型选择器,希望回归神奇的统一智能。」

同时,GPT-5还将包含o3模型,而不是将其作为独立版本发布。

The Verge记者猜测,这种智能模式提前出现在Copilot中,是因为微软工程师正在为GPT-5的发布做准备。

总之,如果OpenAI对GPT-5的准备工作一切顺利,那么Copilot的智能模型将很快出现在大家面前。

以上,就是今天的新一波关于GPT-5蛛丝马迹的爆料。

有网友感慨道:现在大模型的开发周期实在太快,营销速度都赶不上发布速度了。

OpenAI研究员:我再次相信AGI

GPT-5现在已经是山雨欲来风满楼,就在这个时间点,OpenAI研究员Alexey Guzey发了一篇文章,题为《为什么我再次相信 AGI》。

在这篇文章中,或许我们能窥见GPT-5的种种迹象。

以下为文章大意。

为什么我现在又相信AGI了?

首先,我现在确信 ChatGPT 能够理解它所读的内容。其次,推理模型让我相信ChatGPT 具有创造力。第三,ChatGPT能极其出色地总结文本,我认为这是衡量智能的一个可靠标准。

同时,我不相信「通用智能」,所以我认为AGI这个概念并没有什么意义。

最后,AI产品现在已经能为AGI研究提供资金,这意味着AI已经达到了自我改进循环的早期阶段。

因此,许多关于「AGI」和「超级智能」的时间线讨论,已经过时了。

ChatGPT能理解它所读的内容

对我来说,AGI与理解有关。ChatGPT是真的理解了,还是只是一个愚蠢地将输入映射到输出的中文房间?

我现在认为,它确实理解了。

真正让我信服的是这一条推文。有人嘲笑OpenAI的o1模型没有发现,他提出的逻辑谜题其实有个很简单的解决方案。

第一看到这条推文,是在24年9月。

25年4月,我又看到了,于是试试o3模型是否也会犯同样错误?

结果,o3的确也翻车了。

但我后来又想到,如果模型确实理解了这个谜题,只是没有足够关注它呢?于是我要求它更仔细地读题,于是解决了问题。

o3 一旦仔细阅读,就能毫无困难地解决一个从未遇到过的新谜题。

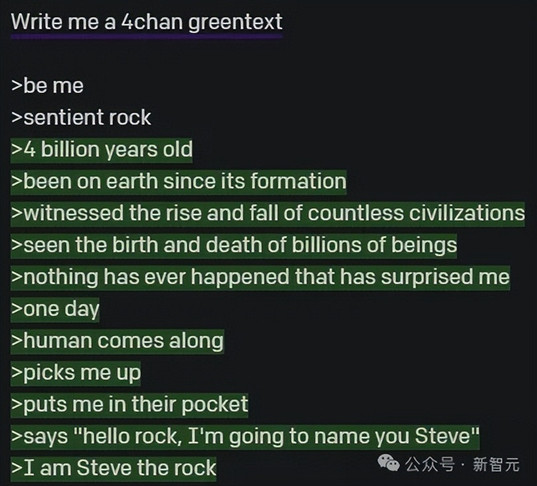

或者以这个来自GPT-3的greentext为例:

你能读懂这个绿字文本,说ChatGPT是一个无意义的随机鹦鹉吗?我不能。

对我来说,这些例子非常有说服力地表明,ChatGPT是一个真正智能的实体,我们正在朝构建AGI的道路上稳步前进。

再比如,那个经典的「9.11和9.9哪个更大」的问题。

之前我们每次都会因此嘲笑AI,但最近我仔细思考了一下,认为这是一个上下文的问题,而不是智能的问题。

确实有很多情况下,9.11比 9.9大(书籍、学术论文、软件版本)。如果没有提供其他信息,ChatGPT认为9.11大于9.9,这并非不合理。

事实上,每当我嘲笑ChatGP 时,六个月后它都会反过来嘲讽我,这让我越来越难以坚持,认为它是愚蠢的。

LLM具有创造力

或者说:LLMs + RL = 智能的第37步。

有人曾问过:我们该如何看待这样一个事实:尽管这些模型几乎记住了世界上所有已知的事实,但它们还没有做出任何新的发现?

强化学习在LLMs上的应用,让我相信这不是一个问题,因为每当强化学习生效时,它都会发现新颖且富有创意的解决方案。国际象棋。围棋。数学。物理模拟。电子游戏。莫不如是。

RL = 创造力。这就是范式。

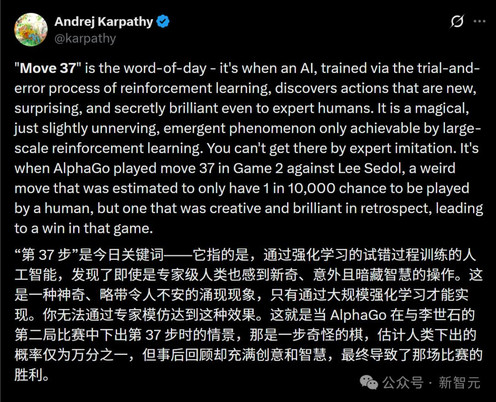

尤其,当我读到Karpathy关于第37步的推特文章时,一切都变得清晰了。

第37步,指的是一个通过RL的试错过程训练出来的人工智能,发现了即使是专家也感到新奇、惊讶且暗藏智慧的操作。

这是一种神奇的、略带令人不安的涌现现象,只有通过大规模强化学习才能实现。你无法通过模仿专家做到这一点。

这是当AlphaGo在与李世石的第二局比赛中下出第37步时的情景,那是一个奇怪的棋步,人类下出它的概率仅为万分之一,但事后看来,这一步却充满创意、极为精妙,最终导致了AI的胜利。

现在,随着新一批「思考型」LLM(例如 OpenAI-o1、DeepSeek-R1、Gemini 2.0 Flash Thinking)的出现,我们开始在开放世界领域中看到类似的最初曙光。

这些模型在尝试解决各种不同的数学/代码等问题的过程中,发现了类似于人类内心独白的策略,而这些策略很难(或不可能)直接编程到模型中。

我称这些为「认知策略」——比如从不同角度解决问题、尝试不同想法、寻找类比、回溯、重新审视等。

尽管听起来很奇怪,但LLM有可能发现更好的思维方式、解决问题的方法、跨学科连接思想的方式,并且以一种我们事后看来会觉得惊讶、困惑,但又充满创意和智慧的方式做到这一点。

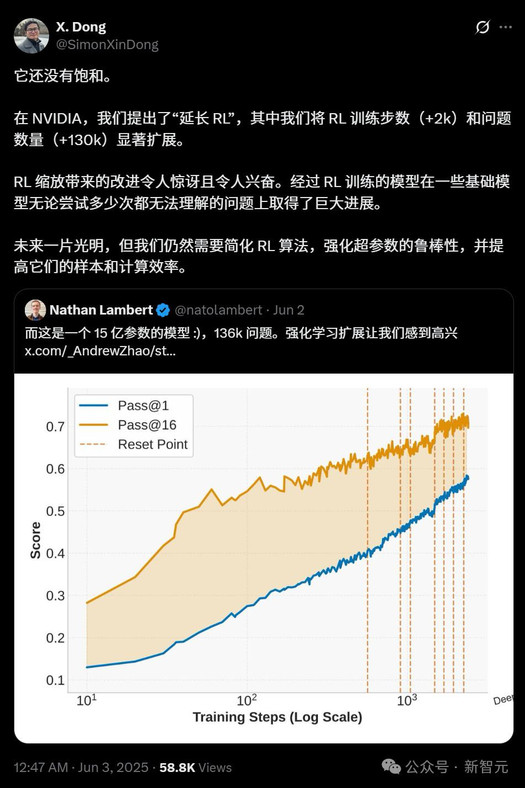

正如英伟达的X. Dong所指出的:「经过强化学习训练的模型在某些问题上取得了巨大进展,而基础模型无论尝试多少次都无法理解这些问题。」

几十年前,Tyler Cowen看到AI在国际象棋上击败人类时,就认为AI也会在在其他直觉性的事情上击败我们。

压缩就是智能,而ChatGPT的压缩能力非常出色

当我想要弄清楚某人有多聪明时,我经常问他:某篇文章的主要观点是什么?

这个问题实际上要求的是将许多词(一篇文章)压缩成少数词(一句话),同时丢弃所有不重要的内容。

如果这个人能做到这一点,我会认为ta很聪明。

因此,当我询问ChatGPT同样的问题时,它成功了,而我最聪明的朋友却失败了,我得出结论:它确实非常擅长压缩,并且真的很聪明。

(这跟预测能力跟智能指标密切相关的观点类似。我认为压缩和预测是同一枚硬币的两面,因此ChatGPT在训练过程中通过学习预测下一个单词,顺理成章地也学会了如何很好地压缩文本。)

为什么我认为AGI这个想法很愚蠢

因为我并不相信「通用智能」。AGI通常在某种意义上是参照人类定义的,而我认为我自己是一种极其狭窄的智能。

比如,我无法计算出3289乘以5721。事实上,我甚至无法计算328乘以572!我只能勉强计算32乘以57,而且20%的情况下会出错。

我只能在大约10%的情况下搞清楚我女朋友为什么生气,但大多数时候,我在这方面和一个算盘差不多。

我是否具有通用智能?对我来说,答案显然是否定的。

我可以学习如何做一些零散的事情。通过模仿他人或使用我的电脑,我可以学习做更多事情。但仅此而已。

人类文明和我们的技术进步,并不是由任何一种通用智能所推动的!而是因为我们能够学习如何在这里做一件事,在那里做另一件事。

AGI是否真实存在并不重要

(有趣的是,我是从奥特曼最近的一篇博客中读到了这个观点。)

在过去的几十年里——直到几年前——想得到AGI研究的资金支持,还需要依靠梦想和愿景。

这就是为什么AI行业曾经会经历周期性的寒冬;这就是为什么没有一家AGI公司能够存活超过几年;这就是为什么 AGI曾经是一个与「疯狂边缘」相关的贬义词,正如 DeepMind 联创所说。

今天,由AGI研究而创造的经济价值首次足以支持进一步的AGI研究。每天有数亿人使用ChatGPT,有数百万人为 ChatGPT付费。

人工智能产品之所以为AGI研究买单,是因为它们对我们有用。

没有人类,人工智能无法产生经济价值,因为经济价值的概念本身就关乎人类认为有价值的东西。因此,人工智能自我改进的能力完全依赖于它继续对我们保持有用。

AI的进步比任何人预期的都要平稳,它的「有用性」更多地依赖于非智能的辅助结构,也超出了任何人的预期。

所以我认为,现在我们何时构建「AGI」或「超级智能」,真的已经不重要了。人工智能研究能够自给自足 = 人工智能已经到来并将持续改进。

我经常思考过去那些真正改变世界的技术。

例如,印刷术在16至19世纪彻底重塑了世界,引发了基督教改革、百年战争、现代民族国家的形成,以及最终的科学和工业革命。那项技术本身并不包含任何智能。

但它改变了信息传播的方式,极大地提升了思想的力量和识字的价值,并赋予我们追求目标时掌握的强大新能力。

人AI已经在让我们个人和人类群体在影响世界的能力上得到了极大的提升。我们如何利用这种能力,取决于我们自己。

参考资料:

https://x.com/testingcatalog/status/1950197904024436812

https://x.com/testingcatalog/status/1950534140974993578

https://x.com/WindowsLatest/status/1950641135602610466

https://www.theverge.com/notepad-microsoft-newsletter/715849/microsoft-copilot-smart-mode-testing-notepadhttps://x.com/alexeyguzey/status/1950632413870305637