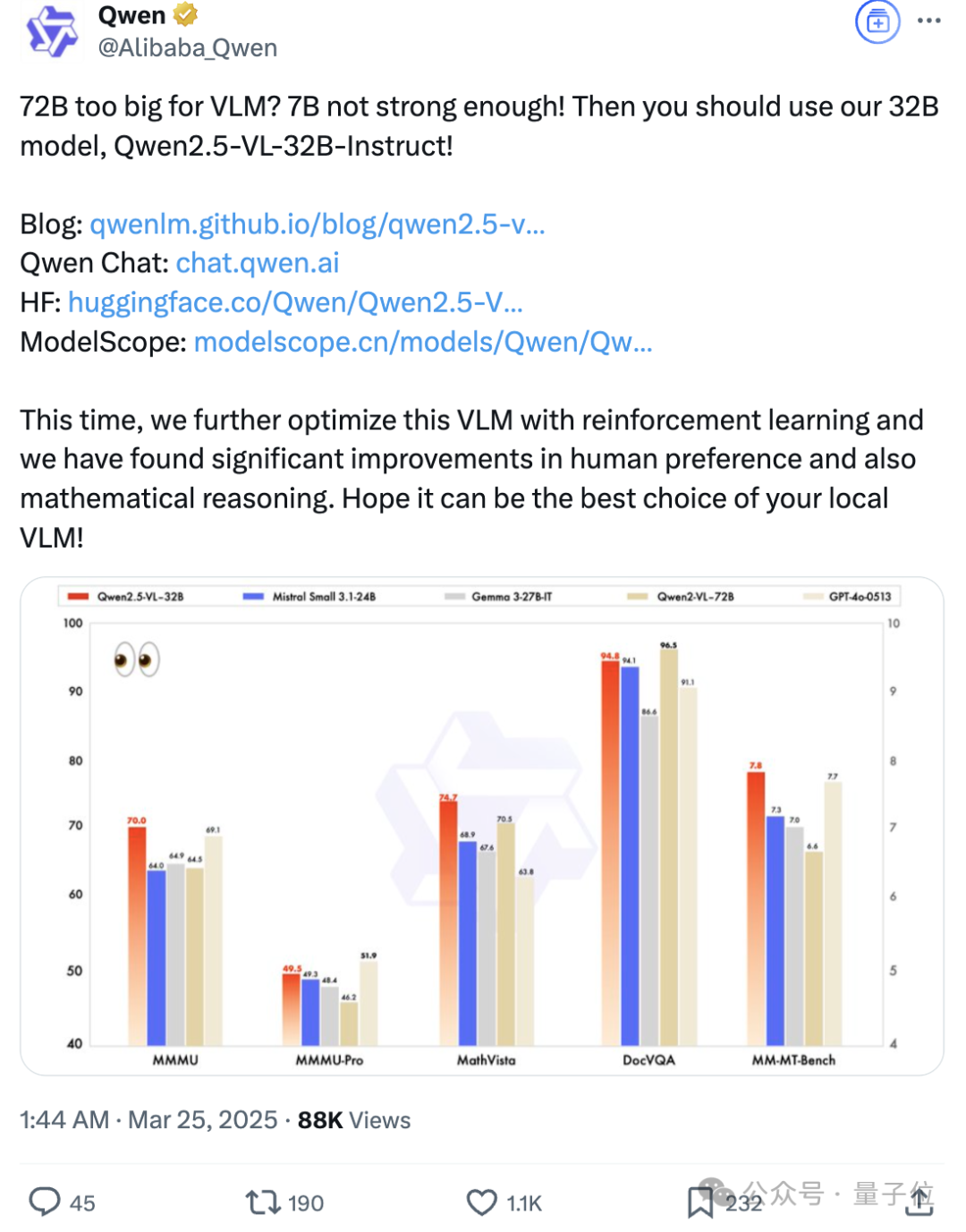

就在 DeepSeek-V3 更新的同一夜,阿里通义千问 Qwen 又双叒叕一次梦幻联动了 —— 发布 Qwen2.5-VL-32B-Instruct。

此前开源家族视觉语言模型 Qwen2.5-VL 包括 3B、7B 和 72B 三种尺寸。

这一次的 32B 版本进一步兼顾尺寸和性能,可在本地运行。同时经过强化学习优化,在三个方面改进显著:

回答更符合人类偏好;

拥有更强的数学推理能力;

在图像解析、内容识别以及视觉逻辑推导等任务中,表现出更强的准确性和细粒度分析能力。

对比近期开源的 Mistral-Small-3.1-24B 、Gemma-3-27B-IT 等,Qwen2.5-VL-32B 在纯文本能力上也达到了同规模的 SOTA 表现。在多个基准上,Qwen2.5-VL-32B 甚至超过了 72B。

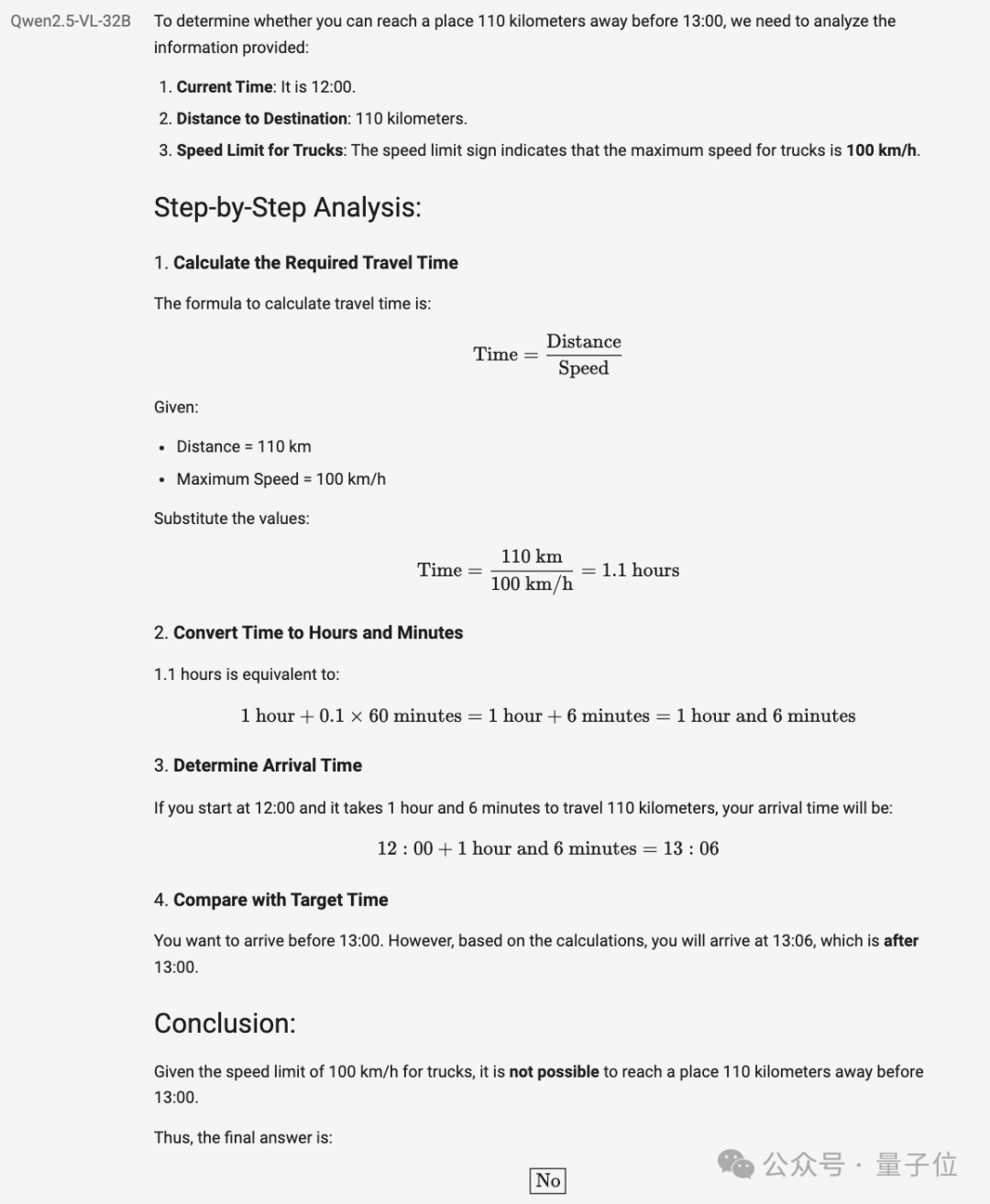

举个栗子,比如根据一张交通指示牌照片,Qwen2.5-VL-32B 就能做如下精细的图像理解和推理:

我正在这条路上驾驶一辆大卡车,现在 12 点了。我能在 13 点之前到达 110 公里远的地方吗?

Qwen2.5-VL-32B 首先对时间、距离、卡车限速进行分析,然后分步骤条理清晰推算出正确答案:

模型已经开源,尽管自己前往实测~

Qwen2.5-VL-32B 更多表现示例

官方刚刚发布的技术博客中也放出了更多展示示例。

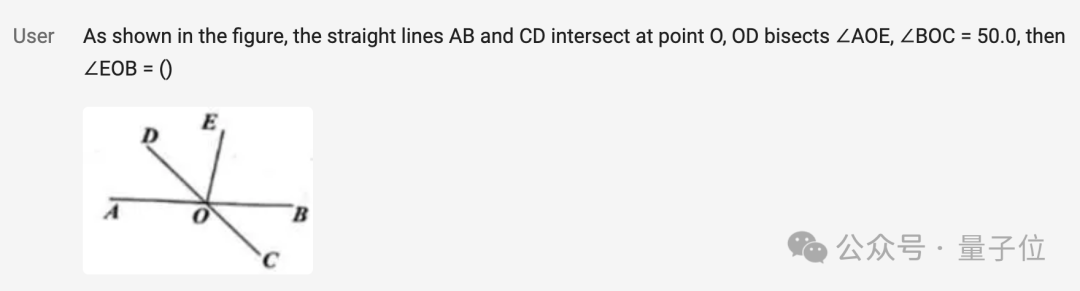

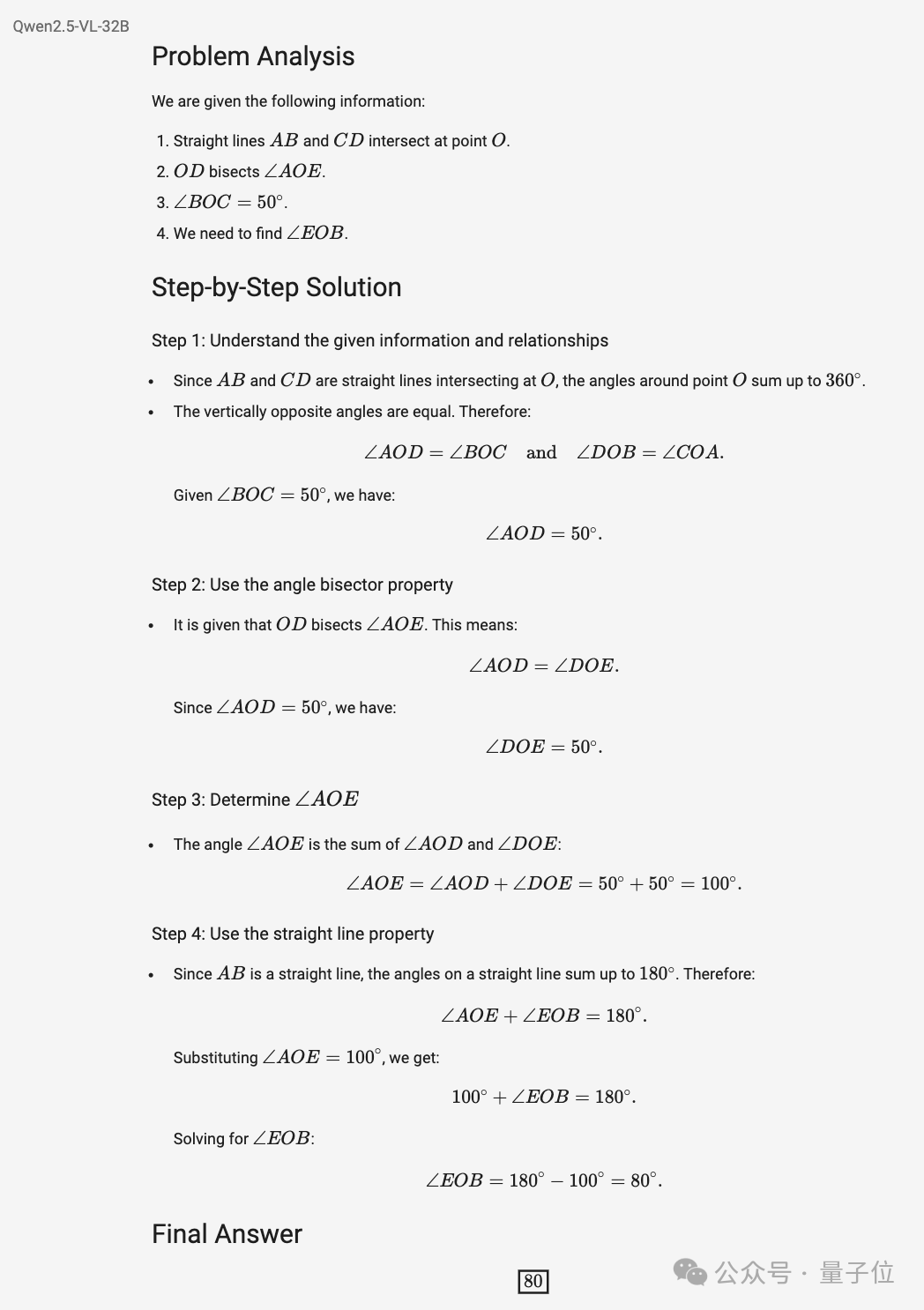

数学推理能力上,几何体分析也不在话下:

同样是先有问题分析环节,然后再分四个小步骤推理正确答案:

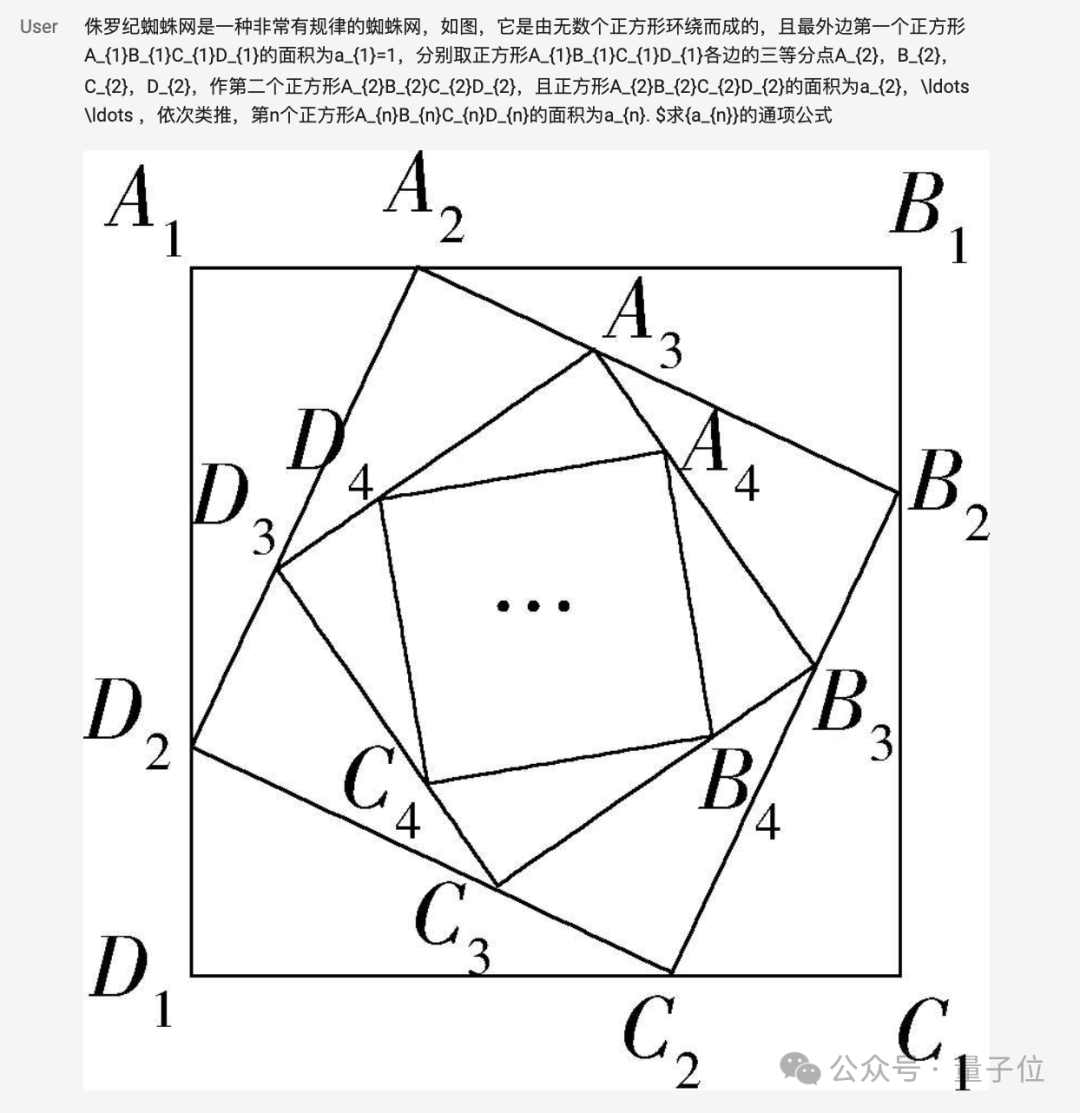

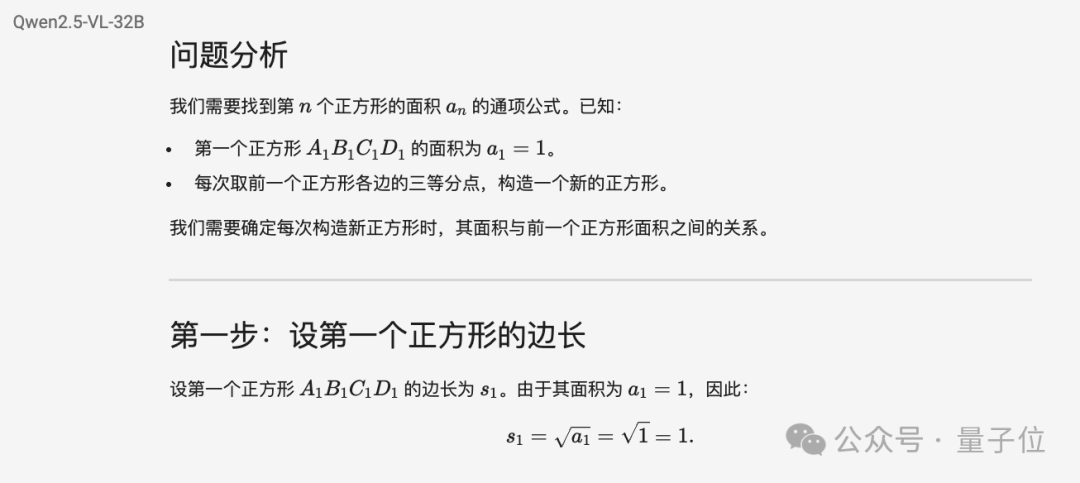

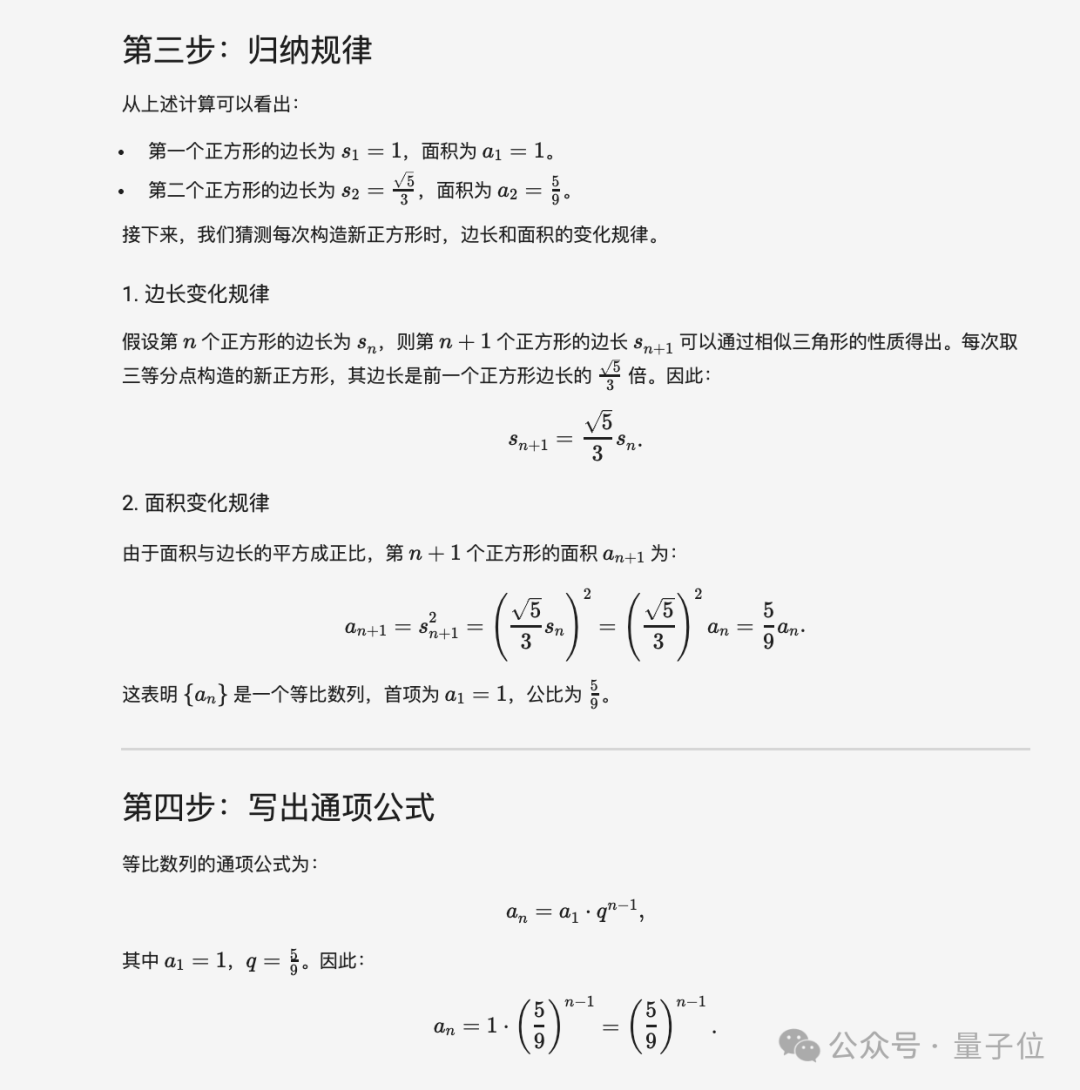

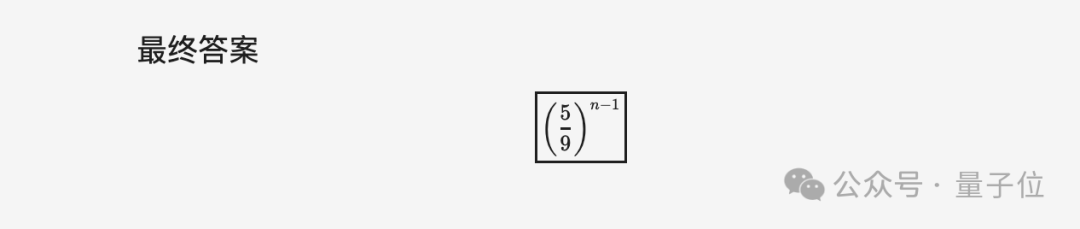

下面这种复杂难题也能解:

能够依次类推,归纳出构造规律:

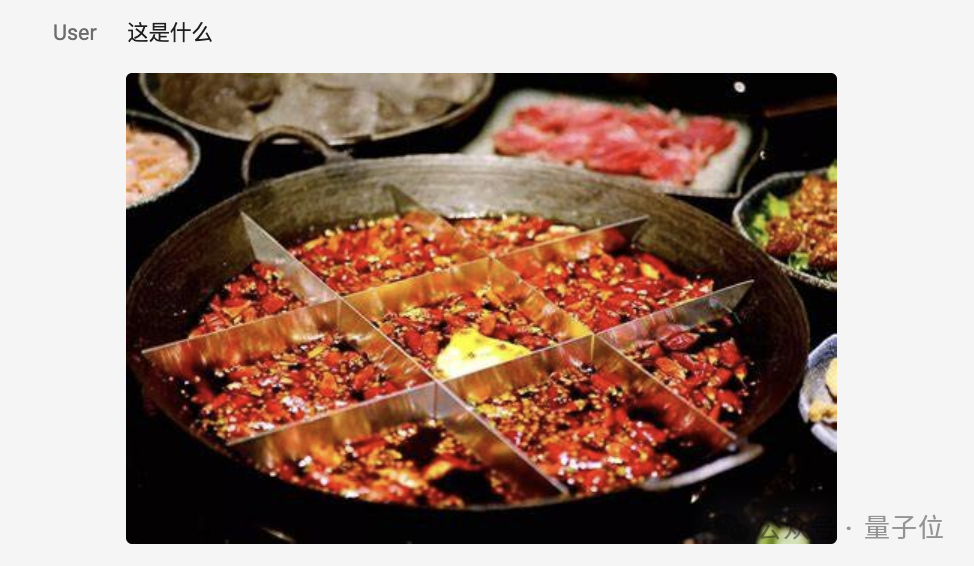

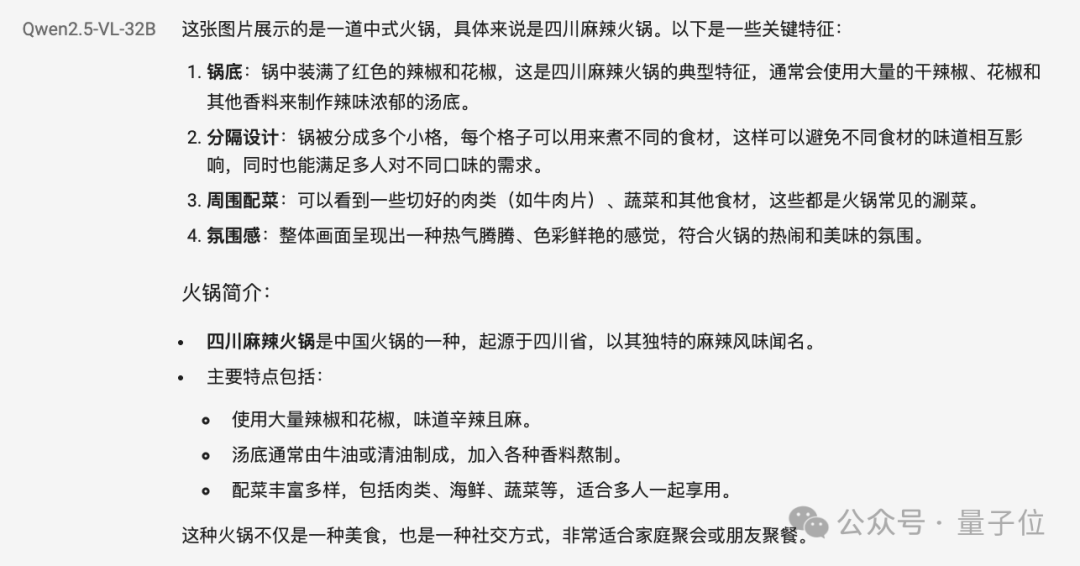

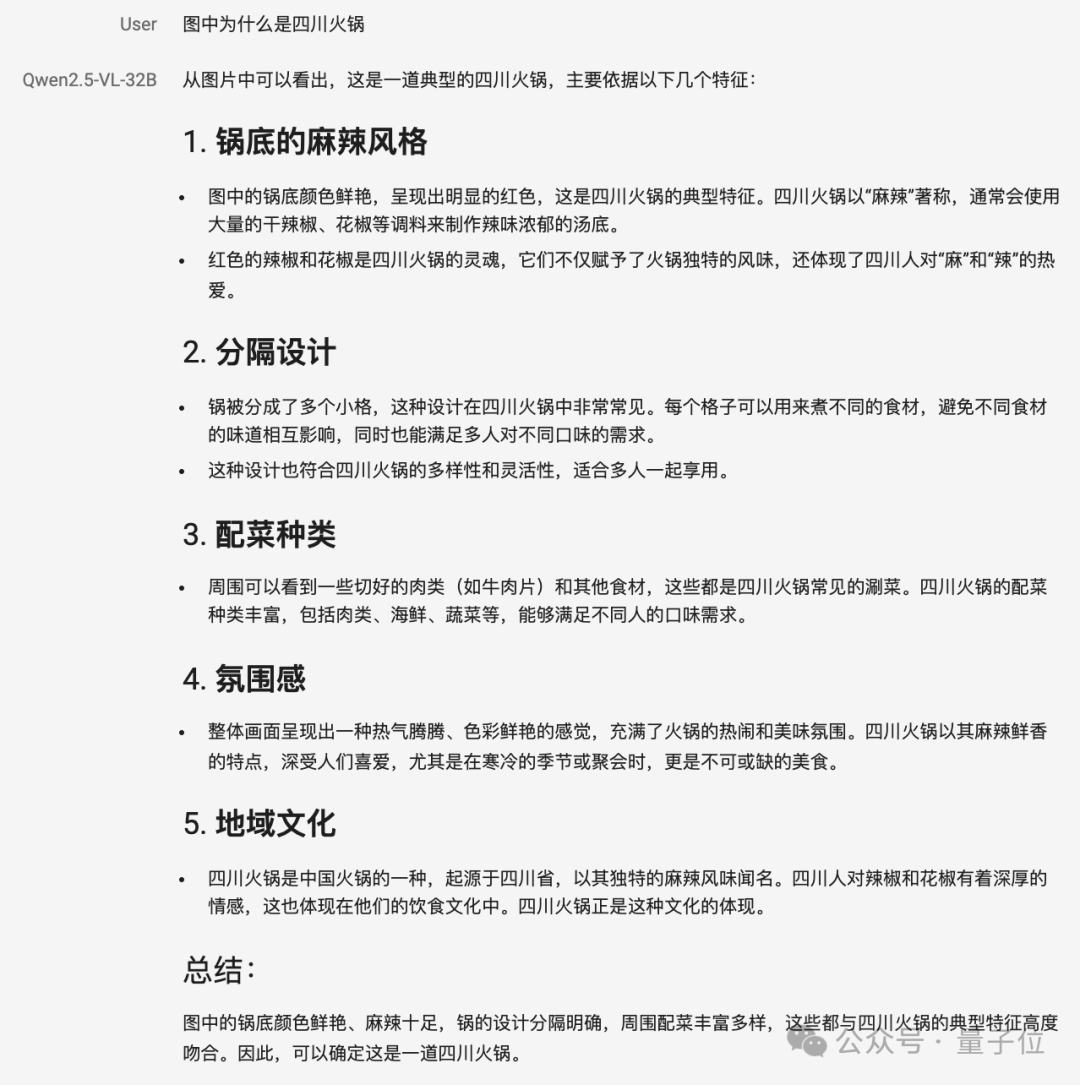

像下面这种图片理解就更不在话下了:

多轮深度提问也可以:

模型开源,已能实测

现在,阿里已将 Qwen2.5-VL-32B-Instruct 放在了 Hugging Face 上。

在 Qwen Chat 上就能直接体验 Qwen2.5-VL-32B,感兴趣的童鞋可以试试。

动作快的网友已经开始在 MLX Community 运行了:

在 Hacker News 上,网友也就 DeepSeek 和 Qwen 的举动进行了新一轮热烈讨论。网友纷纷表示:

开源赢了,奥尔特曼错了。

值得一提的是,春节期间,DeepSeek 曾与阿里通义千问 Qwen 多次几乎同时发布新模型,这一次又双叒叕赶一块去了。

杭州,原来真的是商量着一起发???

参考链接:

[1]https://qwenlm.github.io/zh/blog/qwen2.5-vl-32b/

[2]https://x.com/Alibaba_Qwen/status/1904227859616641534

[3]https://news.ycombinator.com/item?id=43464068

本文来自微信公众号:量子位(ID:QbitAI),作者:西风,原标题《32B 本地部署!阿里开源最新多模态模型:主打视觉语言,数学推理也很强》

广告声明:文内含有的对外跳转链接(包括不限于超链接、二维码、口令等形式),用于传递更多信息,节省甄选时间,结果仅供参考,IT之家所有文章均包含本声明。